― AI市場の上流で起きている「支配の構造」

なぜこのテーマを取り上げるのか

AIを巡る報道では、しばしば「どのモデルが優れているか」「どの企業が次の勝者か」といった話が中心になりやすい。

しかし実際には、AI市場でより重要なのは、誰がAI市場のどこを押さえ、どのように資本を供与し、どのレイヤーで収益化しようとしているのかという構造である。

今回取り上げるWSJの記事は、その点で非常に示唆に富む記事である。この記事は、NVIDIAを単なる「高性能なAIチップ企業」としてではなく、AI市場の上流で、誰を支え、誰を勝たせ、どこに資本を供与するかを左右する存在として描いている。

同じ「AIに積極投資するBig Tech」に見えても、各社が最終的に売っている商品はかなり異なる。

その中でNVIDIAは、AIを動かす処理能力そのものを売る側に位置している。

さらに興味深いのは、NVIDIAの資本供与先を見ると、AI市場の競争軸がどこへ動いているかが見えやすい。

本記事では、まずWSJ記事の内容を整理したうえで、

NVIDIAは何を売り、なぜここまで市場全体に資本を供与しているのか、

そしてそのことが、AI市場の競争構造や資本配分のあり方をどう変えているのかを考えてみたい。

WSJの記事紹介 ~NVIDIAのAI市場における影響力

WSJの “Nvidia CEO’s Night at the Opera Showcases Role as AI Kingmaker” は、NVIDIAのJensen Huangを、単なる半導体企業の経営者ではなく、AI市場において、誰が成長し、どこに資本が流れ、どの企業が競争力を維持できるかに影響を与える存在として描いている。

記事は、Jensen Huangがサンフランシスコのオペラ会場にAI業界の関係者を招いた華やかな場面から始まるが、その背後で描かれているのは、NVIDIAがAI市場の上流で、供給者であると同時に、投資家や資金支援者としても振る舞っているという構造である。WSJはこの構造を、NVIDIAが “industry’s most powerful financier” になったと表現している。

記事によれば、その背景には、NVIDIAの異常な収益力がある。

WSJは、NVIDIAが直近四半期で680億ドルの売上を計上し、**粗利率が75%**に達したことを紹介している。記事中では、MITのPaul Kedroskyが、NVIDIAは “supplier, investor and creditor” の3つを兼ねる “strange position” にあると述べている。

つまりWSJは、NVIDIAを単なるチップ供給者ではなく、AI市場における資金の流れにも強い影響力を持つ企業として描いている。

記事の中で特に象徴的に扱われているのが、Groqを巡る動きである。

WSJによれば、GroqのCEOであったJonathan Rossは、サンフランシスコのオペラ会場に招かれた一人であり、その時点で既にNVIDIA入りの交渉を進めていた。GroqはLPUと呼ばれるチップを手がけており、記事はこれを、AIクエリへの応答速度を高める設計を持つチップとして紹介している。

この記事では、このくだりを通じて、AI市場の競争軸が、学習(training)だけでなく、推論(inference)へと広がっている可能性が示唆されている。

記事では、OpenAIのコーディングツール Codex が注目を集める一方で、OpenAI内部では、NVIDIA製チップでは十分に速く動かせず、ユーザーが長い待ち時間に不満を持っていたと説明されている。OpenAIは、推論の速度や供給制約の観点から、CerebrasやGroqのような代替選択肢も検討していたと報じられている。

その後、WSJによれば、NVIDIAはGroqに対して、通常の買収ではなく、非独占ライセンス契約を結び、同時にJonathan Rossとその主要チームを引き抜いた。

交渉上の評価観としては、Jensen Huangが当初約100億ドルを提示し、Groq側は約300億ドルを求め、最終的には200億ドル規模でまとまったと報じられている。WSJはこれを、NVIDIAにとって過去最大の単一案件だと位置付けている。さらに記事によれば、NVIDIAは2026年3月の開発者会議で、Groq技術を活用した新チップを発表し、OpenAIがその初期顧客の一社になる見通しだとしている。

記事中で比較対象として繰り返し登場するのが、AMDである。

WSJは、AMDがより安価なチップを提供し、技術的にも急速に進歩しているとしつつ、それでもなお苦戦している背景の一つとして、WSJはNVIDIAの資本力にも注目している。その象徴的な事例として、記事は、NVIDIAが2025年にCentMLという小規模スタートアップの買収で、AMDの提示額を知った後にほぼ2倍の価格を提示して競り勝ったケースを紹介している。

この構図をさらに具体的に示しているのが、Poolsideの事例である。

記事では、企業向けに自律的なソフトウェア作成ボットを開発しようとしているAIスタートアップであるPoolsideの共同CEO、Eiso Kantもオペラ会場の招待客として登場する。WSJによれば、Poolsideは2025年、AMDとNVIDIAの両方から計算資源の供給提案を受けていた。しかもその提案は、単なるチップ販売ではなく、「最新世代のチップ供給+それを購入するための出資」 がセットになっていた。

記事によると、NVIDIAはPoolsideに対し、まず5億ドルを投資し、将来の資金調達条件次第では最大10億ドルまで拡大しうる提案を行った。一方、AMDの提示は2.5億ドルだった。Poolsideは最終的にNVIDIAを選び、2025年10月には、テキサス州のデータセンターで、4万基超のNVIDIA製GPUを使う契約を発表した。そのデータセンターの運営主体が、後に登場するCoreWeaveである。

WSJ記事の中で、NVIDIAの資本供与戦略を最も分かりやすく示しているのが、CoreWeaveである。

記事はCoreWeaveを、GoogleやAmazonのような総合クラウドとは異なる、新世代の “neocloud” (AI特化クラウド)として位置付けている。つまり、AI用途に特化したクラウド企業である。WSJによれば、NVIDIAはCoreWeaveの主要株主の一つであり、さらに最新GPUへの早期アクセスも与えている。

それだけではない。記事では、NVIDIAがCoreWeaveに対し、2032年までに、CoreWeaveが顧客に貸し出せなかった場合には、最大63億ドル分のGPUを買い戻す保証まで付けたとされている。この保証によって、CoreWeaveは金融機関からの借入を行いやすくなり、より多くのGPUを購入できるようになる。さらに記事は、CoreWeaveの株価が大きく下落した後の2026年初に、NVIDIAが20億ドルを追加投資し、市場の信認回復を支えたと説明している。その際、CoreWeaveはNVIDIAの次世代チップ群を複数世代にわたって提供すると発表し、株価は一時10%以上上昇した。

AI市場の競争構造や資本配分のあり方

以上を通じて、WSJの記事が描いているのは、NVIDIAの個別投資の羅列ではない。

むしろ、NVIDIAがAI市場の上流で、製品供給者であると同時に、資本供給者としても振る舞っている構造である。

Groq、Poolside、CoreWeaveという事例は、それぞれ別の話に見える。

しかしいずれも、NVIDIAが何を売り、どこに資本を供与し、そのことがAI市場の競争にどう影響しているのかを映している。

ここでは、その構造を整理したい。

AI競争は「何を売っているか」で見ると構造が見える

まず押さえておきたいのは、同じ「AIに積極投資する企業」に見えても、各社が最終的に何を商品として売り、どこで収益を回収しているのかはかなり異なるという点である。

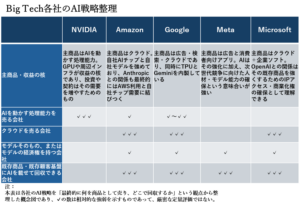

その違いを整理したのが、表1である。

表1:Big Tech各社のAI戦略を「最終的に何を売るか」で整理した比較表

この図で見てほしいのは、AI競争が単一の軸ではなく、複数のレイヤーに分かれているということである。

すなわち、処理能力、クラウド、モデル、既存顧客基盤という4つの役割である。

Microsoft、Amazon、Google、MetaはいずれもAIに巨額投資を行っているが、その多くは、クラウド、企業ソフト、広告、消費者向けアプリといった既存の収益基盤を強化するための投資である。

それに対してNVIDIAは、AIを動かす処理能力そのものを売る企業である。

この違いは重要である。

なぜなら、AI市場が拡大する過程では、まずボトルネックになりやすいのは、それを動かす処理能力だからである。

NVIDIAの強さは、技術だけでなく「資本供給者」であることにある

この立場に加えて、NVIDIAは極めて高い収益性を持つ。

WSJが示したように、同社は四半期で**680億ドルの売上、粗利率75%**という水準にある。

この収益は単なる利益ではない。それは、市場に対して資本を供与する余力である。

WSJの記事で繰り返し描かれているのは、NVIDIAが出資、資金支援、保証といった手段を通じて、顧客やインフラの拡大を支えているという点である。(追記)本稿では、これらを総称して「資本供与」と呼ぶ。

重要なのは、これらが単なる投資ではなく、結果的に将来のGPU需要を生み出す行為として機能していることである。

Poolsideへの出資提案やCoreWeaveへの保証は、その象徴である。

したがって、NVIDIAの優位性は、単に「良いチップを持っている」ことだけでは、十分には説明しきれない。

少なくとも現在のAI市場では、製品供給と資本供与を一体化できることが、NVIDIAの競争力の一部として機能している。

競争の焦点は「総合型」から「AI特化型」を含む方向へ広がっている

WSJの記事がもう一つ示しているのは、AI市場における競争軸そのものが変化しているという点である。

Groqの事例が象徴的である。

ここで描かれているのは、AIの競争が、単なる学習性能ではなく、推論における応答速度や処理効率にも広がっているということである。

また、CoreWeaveの事例は別の側面を示している。

それは、従来のAWSやGoogle Cloudのような総合クラウドとは異なり、AI用途に最適化されたクラウドインフラが、総合クラウドとは別の競争軸として存在感を増している。

つまり現在の競争は、GPU単体ではなく、ネットワーク、データセンター設計、電力、推論処理、運用能力といった、AIを動かすための基盤全体に広がっている。

これは、総合クラウドが不要になるという話ではない。

むしろ、総合型の上に、AI特化型の競争レイヤーが重なったと理解する方が実態に近い。

そしてNVIDIAは、その基盤レイヤー全体に関与できる位置にいる。

Groq案件が示すのは、「AI時代の取り込み方」の変化である

この構造変化を最も象徴しているのが、Groqの案件である。

WSJが描いているのは、NVIDIAがGroqを単純に買収したのではなく、

非独占ライセンス契約と人材の移籍を組み合わせる形で、技術と人材を取り込んだという点である。

これは従来のM&Aとはやや異なる。

従来の買収は、会社全体を取得し、資産・人員・契約を一括で取得する形が基本だった。

しかしAI分野では、企業価値の中心は、人材、モデル設計、ソフトウェアスタックにあり、必ずしも会社全体を取得する必要はない。

その結果として、ライセンスによる技術確保とキーパーソンの移籍を組み合わせることで、

より速く、より柔軟に競争力を取り込む手法が成立しつつある。

これは、MicrosoftによるOpenAIとの関係が示す**「権利の確保」、Metaが進める「人材の確保」**とも部分的に重なる。

その意味でGroqの案件は、Microsoft型の権利確保とMeta型の人材確保を、同一対象に対して短期間に集中的に実行したものとして読むこともできる。(追記)この点は知識ボックス⑦で、M&Aの観点から補足する。

日本の若手金融マンは何を見るべきか

このテーマを日本の若手金融マンが読むうえで重要なのは、

「どのAI企業が勝つか」を当てることではない。

むしろ見るべきなのは、どの企業がAI市場のどのレイヤーに立ち、何を売り、どこで回収し、どこに資本を供与しているのかである。

金融の仕事では、しばしば「AI市場は伸びる」「Big Techが強い」といった抽象的な言い方で議論が済まされがちである。

しかし実際には、誰がどのレイヤーで収益化しているかを分けて見なければ、競争構造も、企業価値の源泉も、資本配分の意味も見えにくい。

今回のNVIDIAの事例が示しているのは、

AI市場で上流に立つ企業の強さは、必ずしもモデル性能だけで決まるわけではないということである。むしろ、市場全体が成長するために必要なボトルネックを押さえ、その周辺に資本を供与できる企業の方が、より上流に立てる可能性がある。

これはAIに限らない。

金融や資本市場の観点から見れば、重要なのは多くの場合、どのプレイヤーが最も上流で、最も再現性の高い形で需要や収益を取り込めるかという点である。

その意味で、NVIDIAを単なる「半導体企業」や「AI銘柄」として見るだけでは、この構造は見えにくい。

今回のWSJ記事は、NVIDIAをAI市場の資本供給者であり、競争の方向そのものに影響を与える存在として読むことで、はじめて面白くなる。

知識ボックス

①|Groqとは何か

Groqは、AIの推論(inference)処理に強みを持つ半導体企業である。

設立者のJonathan Rossは、GoogleでTPU(Tensor Processing Unit)の開発に関わった人物として知られている。

Groqが特徴的なのは、GPUではなく、**LPU(Language Processing Unit)**と呼ばれる独自アーキテクチャを前面に出している点である。

ざっくり言えば、GPUが「多目的で並列処理に強い汎用計算装置」であるのに対し、Groqは、大規模言語モデルの推論処理を高速・低遅延で回すことに重点を置いている。

なぜ推論で注目されたのか。

それは、AI市場の競争が、モデルの学習性能だけでなく、実際にユーザーへ応答を返す速度やコストに移ってきたからである。

チャット、コーディング支援、エージェント型AIのように、ユーザーとのリアルタイム対話が重要になるほど、推論性能の価値は高まる。

その意味でGroqは、NVIDIAの代替というより、推論特化という別の最適化方向を示した企業として理解すると分かりやすい。

②|Cerebrasとは何か

Cerebrasは、巨大なウェハースケールチップで知られるAI半導体企業である。

通常の半導体は、一枚のシリコンウェハーから多数の小さなチップを切り出して作るが、Cerebrasは、ウェハーそのものをほぼ一枚まるごと一つの巨大チップとして使うという発想で設計されている。

この構造によって、同社は、学習(training)と推論(inference)の両方で、巨大モデルを高効率で扱うことを狙っている。

特に、モデルの並列処理やメモリ配置の観点で独自性が強い。

OpenAIが一時的にCerebrasに関心を持ったとされる背景には、単に「NVIDIA以外を試したい」という話だけでなく、推論の速度や供給制約、運用上の柔軟性への問題意識があったと考えられる。

NVIDIA代替として何が違うかを一言で言えば、Cerebrasは、GPUの延長線ではなく、AI向け計算装置そのものを別の設計思想で作ろうとしている企業である。

③|Poolsideとは何か

Poolsideは、企業向けのコーディングAI・ソフトウェアエージェントを開発しようとしているスタートアップである。

ここでいう「コーディングエージェント」や「自律的ソフトウェア作成」とは、単にコード補完を行うだけでなく、複数の工程をまたいで、ある程度まとまった開発作業をAIが担う方向性を指す。

この種のAIは、単発のチャット応答よりも、長い文脈を保持しながら大量のトークンを処理する必要があり、推論負荷も高い。

そのため、GPUやAIインフラへの需要が非常に大きくなりやすい。

PoolsideがAMDとNVIDIAの争奪対象になったのは、同社が単なるアプリ企業ではなく、将来的に巨大な計算需要を生む可能性のある顧客だったからである。

つまり、Poolsideへの出資は、ソフトウェア企業への投資であると同時に、将来のインフラ需要の囲い込みでもあったと理解できる。

④|CoreWeaveとは何か

CoreWeaveは、AI用途に特化したクラウド企業であり、しばしば “neocloud” と呼ばれる。

これは、AWSやGoogle Cloudのような総合クラウドとは異なり、GPU中心のAIワークロードに最適化されたインフラを提供する会社という意味である。

同社の強みは、単にGPUを並べて貸すことではなく、AI向けに最適化された運用、ネットワーク、データセンター設計にある。

そのため、学習や推論に大規模な計算資源を必要とするAI企業にとって、総合クラウドより魅力的な選択肢になることがある。

NVIDIAとの関係が深いのは、CoreWeaveが、NVIDIA製GPU需要の大きな受け皿になっているからである。

一方で苦戦材料もある。

株価下落や市場不安が示しているのは、AI特化クラウドが有望である一方、設備投資・借入・需要見通しへの依存が大きいということである。

つまりCoreWeaveは、AI市場の成長を映す企業であると同時に、その過熱や不安定さも映す企業でもある。

⑤|推論(inference)とは何か

AIを理解するうえで、**推論(inference)と学習(training)**の違いは非常に重要である。

学習とは、モデルに大量のデータを読ませて、重みを更新しながら能力を獲得させる工程である。

一方、推論とは、学習済みのモデルを実際に使って、ユーザーの入力に対して応答を返す工程である。

これまでAI競争では、主に「どれだけ大きなモデルを学習できるか」が注目されてきた。

しかし現在は、チャットAI、コーディングAI、エージェント型AIの普及によって、どれだけ速く、安く、安定して推論を回せるかが競争の焦点になりつつある。

CodexやコーディングAIとの関係で言えば、ユーザーは単に「正しい答え」だけでなく、待たされないことを強く求める。

数秒の遅れでも、プロダクトの体験価値は大きく変わる。

そのため、推論において重要なのは、単なる計算能力だけでなく、低遅延、効率、運用コスト、応答の安定性である。

GroqやCerebrasのような企業が注目されるのは、この領域に別の最適化余地があるからである。

⑥|Reflectionとは何か

Reflectionは、オープンソースAIモデルの開発を目指す新興企業である。

WSJ記事では、NVIDIAが同社の資金調達ラウンドで**アンカー投資家(中核出資者)**として機能した事例として紹介されていた。

本文で詳しく扱わなかったのは、Groq、Poolside、CoreWeaveの3社で、すでに

推論、AI需要、AI特化インフラという主要論点が十分に説明できるからである。

ただしReflectionの事例も、構造としては重要である。

これは、NVIDIAがモデル企業そのものにも早い段階で資金を入れ、その資金が結果的にGPU需要へ戻ってくる可能性のある構造を示している。

その意味でReflectionは、本文で扱った3事例とは別方向から、

「資金供与→AI需要→NVIDIA需要」 という循環を補足する事例と位置付けることができる。

⑦|Groq型の「ライセンス+人材移籍」は、新しい買収手法といえるのか

Groq案件が興味深いのは、単にNVIDIAが推論技術を取り込んだという点だけではない。

その取り込み方そのものが、AI時代の企業買収の変化を示している可能性があるからである。

従来のM&Aでは、競争力を取り込む方法は比較的明快だった。

会社全体を買収し、資産・人材・契約を一括で取得するという形である。

しかしAI分野では、価値の中心が工場や設備ではなく、人材、モデル、データ、設計、ソフトウェアスタックといった無形資産に偏りやすい。

その結果、必ずしも会社全体を買わなくても、価値の中核だけを取り込むことが可能になる。

この観点から見ると、Groq型の手法は興味深い。

MicrosoftとOpenAIの関係が示しているのは、主として**「権利の確保」である。

一方、Metaが近年強めているのは、主として「キーパーソンの確保」**である。

それに対してGroq型は、ライセンスによる権利確保と、人材移籍による中核人材の確保を、同一対象に対して短期間・高密度で実行したものと見ることができる。

この手法が金融・M&Aの観点から重要なのは、少なくとも三つの理由がある。

第一に、規制当局が「普通の買収」に厳しくなっていることである。

Big Techによる大型買収は、反トラストや競争政策の観点から審査が厳しくなりやすい。

そのため、フル買収ではなく、ライセンス、提携、少数出資、人材移籍を組み合わせる方が、実質的な競争力の確保をしやすい。

第二に、AI企業では、価値の中心が無形資産にあることである。

工場や設備の取得よりも、誰がそのモデルや設計を担っているかの方が重要であるならば、会社全体を取得しなくても、経済的には十分な意味を持ちうる。

第三に、フル買収より速いことである。

AI市場では、1年の遅れが大きな差になる可能性がある。

その意味で、Groq型の手法は、AI時代における「実質買収」の一つの形として、今後も繰り返し現れる可能性がある。

したがって、この案件は単なる個別ニュースというより、

AI時代には、企業買収そのものの形式も変わりうることを示唆する事例として読むことができる。

参照記事

2026年3月23日 The Wall Street Journal記事

“Nvidia CEO’s Night at the Opera Showcases Role as AI Kingmaker”

※ 本ブログは投資助言や特定の取引を推奨するものではありません。

内容は一般的な論点整理を目的としたものであり、最終的な判断は読者ご自身で行ってください。